Quando nel 2007 Apple presentò iPhone, non lanciò soltanto un nuovo telefono. Cambiò la forma dell’oggetto, il modo di interagire con la tecnologia, l’architettura delle interfacce e da quel momento, tutto il settore iniziò ad adeguarsi.

Quando una rivoluzione funziona davvero, però, spesso succede una cosa precisa: dopo la rottura iniziale arriva una lunga fase di stabilizzazione. Ed è esattamente quello che è successo anche agli smartphone.

Oggi gli smartphone sono prodotti potentissimi, rifiniti, efficienti, perfettamente inseriti in ecosistemi sempre più integrati. Eppure se li guardiamo con gli occhi da designer, ci rendiamo conto che la forma archetipica si è cristallizzata in un fronte quasi tutto schermo, un corpo sottile, un rettangolo di vetro e metallo. E ogni nuovo modello porta solo piccole variazioni, ovvero un nuovo colore, un diverso gruppo fotocamere, l’aggiunta di un tasto, una cornice un po’ più sottile.

L’innovazione non si è fermata, bensì si è spostata. Si è redistribuita su performance, chip, elaborazione fotografica, batterie, materiali, continuità tra device, servizi, efficienza. Tutte innovazioni reali, ma (quasi) mai capaci di cambiare in profondità il paradigma d’uso.

In altre parole, gli smartphone continuano a migliorare, ma difficilmente ci costringono a imparare un modo nuovo di usarli.

Lo stesso discorso vale per i sistemi operativi. Il primo iPhone OS è stato rivoluzionario perché ha definito un modello ancora attuale: home screen, icone, app, notifiche, impostazioni, store, gesture, contenitori. Negli anni le interfacce sono diventate più veloci, più pulite, più dense, più animate e più personalizzabili, però l’architettura di base è rimasta sorprendentemente stabile.

Di fatto, il sistema operativo mobile contemporaneo funziona principalmente come un ambiente che organizza accessi a software separati, installati da uno store, con logiche abbastanza coerenti da piattaforma a piattaforma.

Le app fanno il lavoro specifico, mentre l’OS media, ordina, notifica, autorizza e collega. È un modello talmente efficace da essere uscito dai telefoni e aver contaminato altri mondi. Basta osservare le interfacce automotive per rendersene conto: schermate modulari, icone, widget, contenitori, gesture, profili e servizi sincronizzati ricordano sempre di più il comportamento di uno smartphone.

È cambiato molto il livello di finitura, molto meno il paradigma.

Negli ultimi anni i grandi player sembrano aver cambiato terreno di sfida:

Tutto molto interessante, anche perché racconta bene una tensione contemporanea del design digitale: in un mercato in cui l’architettura di base è ormai consolidata, il linguaggio visivo torna a essere un elemento competitivo molto forte.

Ma basta questo per parlare di vera innovazione d’uso? No, spesso non basta.

Una UI più espressiva non coincide automaticamente con una UI più trasformativa. Può essere più piacevole, più riconoscibile, più personale e più coinvolgente, ma non necessariamente cambia il rapporto tra utente e sistema.

Ormai ogni riflessione sul futuro della tecnologia passa inevitabilmente dall’intelligenza artificiale. L’uso dell’AI sembrava chiaro già anni fa (prima ancora dell’hype degli ultimi 2 anni): se il telefono è sempre con noi, conosce il contesto e raccoglie input continui, allora l’assistente intelligente sarebbe dovuto diventare il vero centro dell’esperienza mobile.

Siri, introdotta da Apple nel 2011 con iPhone 4S, è stata la prima manifestazione mainstream di questa promessa. Parlare al telefono per attivare azioni, cercare informazioni, impostare promemoria, aprire servizi: sembrava l’inizio di una nuova interfaccia, poi però quella value proposition si è fermata a metà. Siri è ancora utile, ma raramente decisiva e non è migliorata molto negli anni.

Con l’AI generativa, sembrava finalmente arrivato il momento di cambiare passo: Apple Intelligence da un lato, Gemini dall’altro e in generale una nuova generazione di assistenti sempre più conversazionali e contestuali.

Apple ha presentato Apple Intelligence nel 2024, promettendo miglioramenti significativi a Siri, tra cui funzionalità più personali, una migliore comprensione del contesto e avvisi avanzati. A oggi, tuttavia, molte di queste funzionalità annunciate non sono ancora state implementate o non si sono rivelate impattanti come Apple e tutti noi ci aspettavamo.

L’AI è arrivata sugli smartphone, ma nella maggior parte dei casi potenziando il paradigma esistente invece di sostituirlo. Riassume notifiche, riscrive testi, genera immagini, organizza informazioni, aiuta nelle ricerche, interpreta richieste e attiva funzioni, ma continua quasi sempre a operare all’interno di una struttura progettata prima dell’AI stessa.

Per questo – almeno per ora – l’assistente intelligente è più un livello aggiuntivo che una nuova architettura d’interazione.

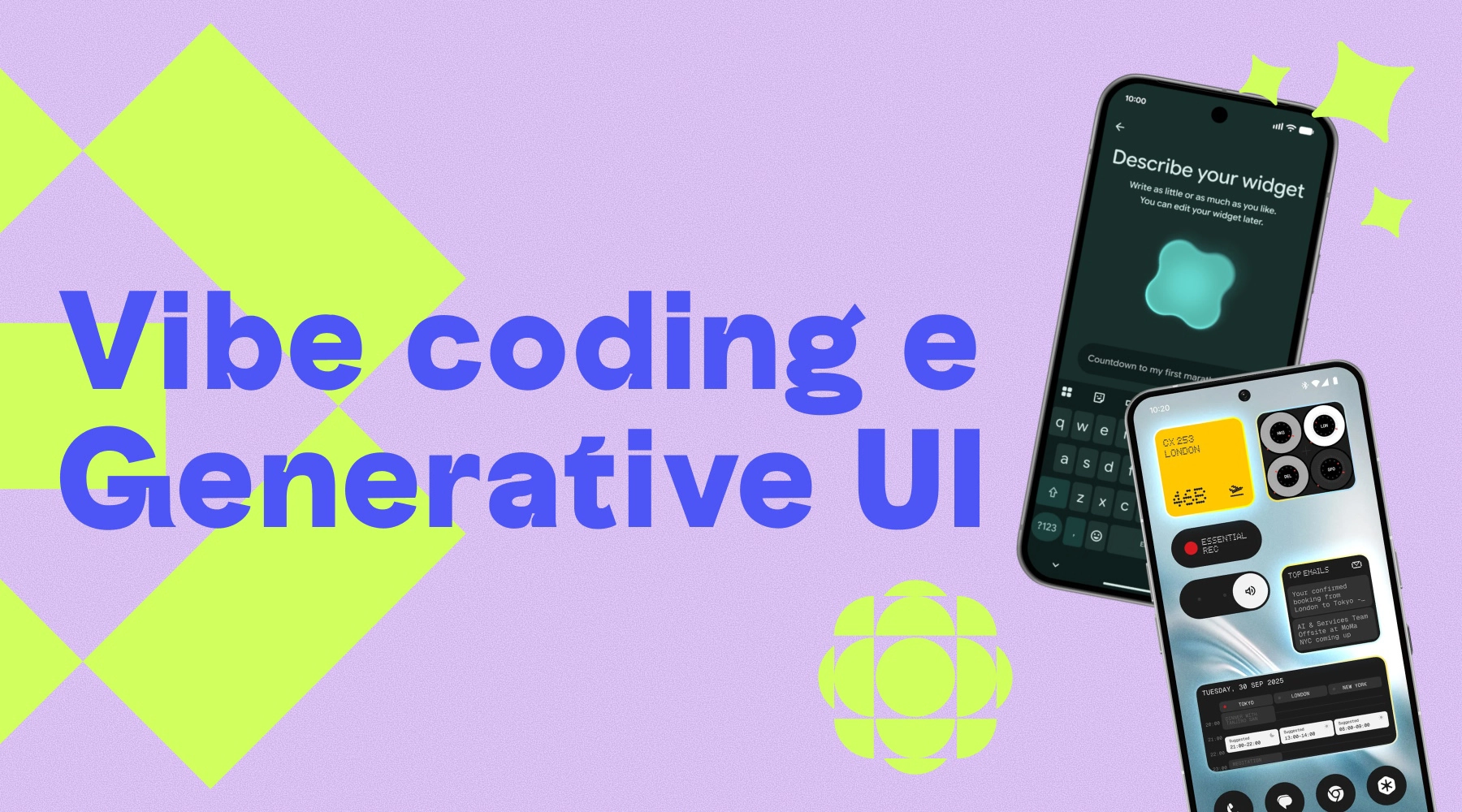

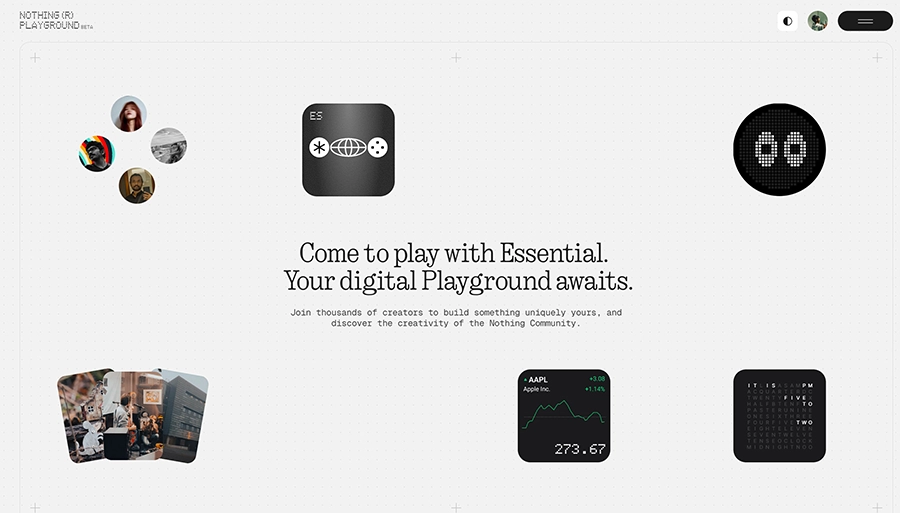

Con il Nothing Playground (lanciato a settembre 2025), Nothing ha iniziato a mostrare un modello diverso: attraverso una piattaforma dedicata gli utenti possono generare mini-app o widget utilizzando semplici prompt testuali. I widget sono poi disponibili per essere usati direttamente nel proprio smartphone e condivisibili con la community nothing.

La piattaforma è funzionante, anche se ancora in beta, e i widget presentano diversi limiti:

Sono ancora segnali deboli e non vere e proprie certezze, ma proprio per questo vale la pena osservarli con attenzione: il punto non è capire se Nothing abbia già costruito il futuro del mobile, è che sta rendendo visibile una domanda progettuale che finora era rimasta soprattutto teorica.

Questa domanda è sorta qualche settimana fa, durante una riflessione con Chiara Pizzo, studentessa di design del SID. Raccontando la sua idea di tesi ispirata proprio ai widget personalizzati di Nothing, Chiara si chiedeva se fosse possibile generare widget capaci di ottimizzare l’interfaccia per l’usabilità di persone anziane o con disabilità.

Durante la conversazione ci siamo chiesti:

se oggi possiamo generare widget nativi personalizzati, perché domani lo stesso approccio non potrebbe essere applicato all’intero sistema operativo?

Negli ultimi quindici anni abbiamo vissuto dentro un paradigma semplice: milioni di persone usano la stessa identica app, progettata una tantum e distribuita in massa. Al massimo si personalizzano alcuni dettagli, si cambiano preferenze, si attivano funzioni e si spostano widget. Ma il software, di base, resta lo stesso per tutti.

L’AI generativa e il vibe coding potrebbero iniziare a incrinare questa logica.

Uno studente potrebbe generare uno strumento di studio pensato sul proprio metodo.

Un freelance, un micro-tool per preventivi, ore e scadenze.

Un atleta, un tracker molto più aderente alla propria routine.

Una persona anziana, un’interfaccia più leggibile, essenziale, semplificata.

Una persona con disabilità, una configurazione più adatta alle proprie capacità e al proprio contesto.

Il tema smette di essere tech demo e diventa immediatamente umano. Perché se oggi riusciamo a generare widget, componenti o piccoli flussi, in futuro non dovrebbe accadere lo stesso a porzioni sempre più grandi dell’interfaccia?

Per chi progetta, questa traiettoria non arriva dal nulla.

Nel 2011, ho scritto – NdR Chris – una tesi sulle identità visive dinamiche, in cui evidenziavo una distinzione importante: non progettare una forma chiusa, ma un sistema. Non fissare un solo output, ma definire una grammatica, un processo generativo, un insieme di regole capaci di produrre variazioni coerenti.

Oggi, portata dentro la UX/UI, quella stessa logica diventa ancora più interessante: un’interfaccia dinamica non è semplicemente una schermata che cambia colore, non è una skin, non è una dark mode e non è nemmeno solo personalizzazione estetica. È un sistema che si adatta a contesto, contenuto, capacità, obiettivo, comportamento, momento d’uso.

In parte succede già: le interfacce reagiscono al device, al tema, alla lingua, alla cronologia, alle preferenze, ai dati. Sistemi come Material 3 fanno della personalizzazione cromatica e comportamentale una parte esplicita del framework.

Altro esempio pratico è Netflix.

Anche se spesso non ce ne accorgiamo, Netflix personalizza già una parte importante dell’esperienza in base alla profilazione utente, alla cronologia di visione e ai segnali comportamentali. Questo significa che due persone, nello stesso momento, possono vedere una home diversa, un ordine diverso dei contenuti e persino immagini di copertina differenti per lo stesso identico film o serie. Netflix lo ha spiegato apertamente nel proprio Tech Blog: per molti titoli esistono più artwork promozionali e il sistema sceglie quale mostrare a ciascun utente in base a ciò che ha più probabilità di attirarne l’attenzione.

Ecco il vero cambio di paradigma: non più soltanto adattività decisa dall’azienda, bensì adattività generabile anche a partire dal bisogno esplicito del singolo utente.

Se questo scenario si sviluppa davvero, cambia il ruolo stesso del sistema operativo: nei sistemi attuali l’OS gestisce risorse, permessi, notifiche, servizi, finestre, input, app; in uno scenario più avanzato potrebbe diventare anche una piattaforma di generazione di strumenti.

Non più solo ambiente che ospita software, ma anche infrastruttura che aiuta a produrlo.

A quel punto, l’AI non sarebbe semplicemente un’assistente che apre app al posto nostro,

piuttosto un mediatore tra bisogno e strumento: l’utente esprime un bisogno, il sistema interpreta il contesto e genera una soluzione temporanea, mirata, personale. Non perfetta né definitiva, ma sufficiente, utile, situata.

Ed è qui che cambia anche il mestiere del designer.

Perché se l’interfaccia non è più un output fisso, allora progettare non significa solo disegnare schermate. Significa definire regole, comportamenti, priorità, limiti, sicurezza, accessibilità, coerenza. In altre parole: non più solo comporre superfici, ma progettare grammatiche.

Probabilmente non sarà soltanto un altro rettangolo nero leggermente più sottile, né una fotocamera spostata di pochi millimetri o un nuovo effetto vetro raccontato come rivoluzione definitiva dell’interazione.

Il futuro degli smartphone (forse) sarà meno spettacolare da vedere, ma molto più radicale da progettare.

Potrebbe riguardare sistemi operativi più fluidi, adattivi, personali e context-aware. Sistemi capaci non solo di ospitare strumenti, ma anche di generarli a partire dai bisogni delle persone. Questo non significa che le app spariranno o che il modello attuale sia finito, né che Nothing abbia già indicato la strada definitiva.

Però una cosa sembra iniziare a emergere: dopo anni di stabilità, una piccola crepa nel paradigma dello smartphone si comincia a vedere.

Mentre stavamo revisionando questo articolo prima della pubblicazione, durante il The Android Show: I/O Edition 2026, Google ha presentato Create My Widget, una nuova funzione che permette di generare widget personalizzati tramite linguaggio naturale e che l’azienda stessa ha definito come “il primo passo verso una generative UI”. Google la inserisce dentro il nuovo ecosistema di Gemini Intelligence, immaginandola non come semplice tool estetico, ma come un modo per creare strumenti più personali, dinamici e utili direttamente a partire dai bisogni dell’utente.

Rispetto ai widget di Nothing, l’approccio di Android sembra partire da un livello di integrazione più profondo con il sistema operativo.

Proprio perché si appoggia all’infrastruttura Gemini e ai servizi dell’ecosistema Android, Create My Widget sembra aprire a scenari più ampi: non solo piccoli elementi personalizzati da mostrare in home, ma widget capaci di dialogare con dati, contesto e funzioni di sistema in modo più articolato. È ancora presto per parlare di vero cambio di paradigma, ma il segnale è chiaro: l’idea di una UI generativa non è più una suggestione teorica o un esperimento isolato, sta iniziando a diventare una direzione concreta anche per i grandi sistemi operativi.